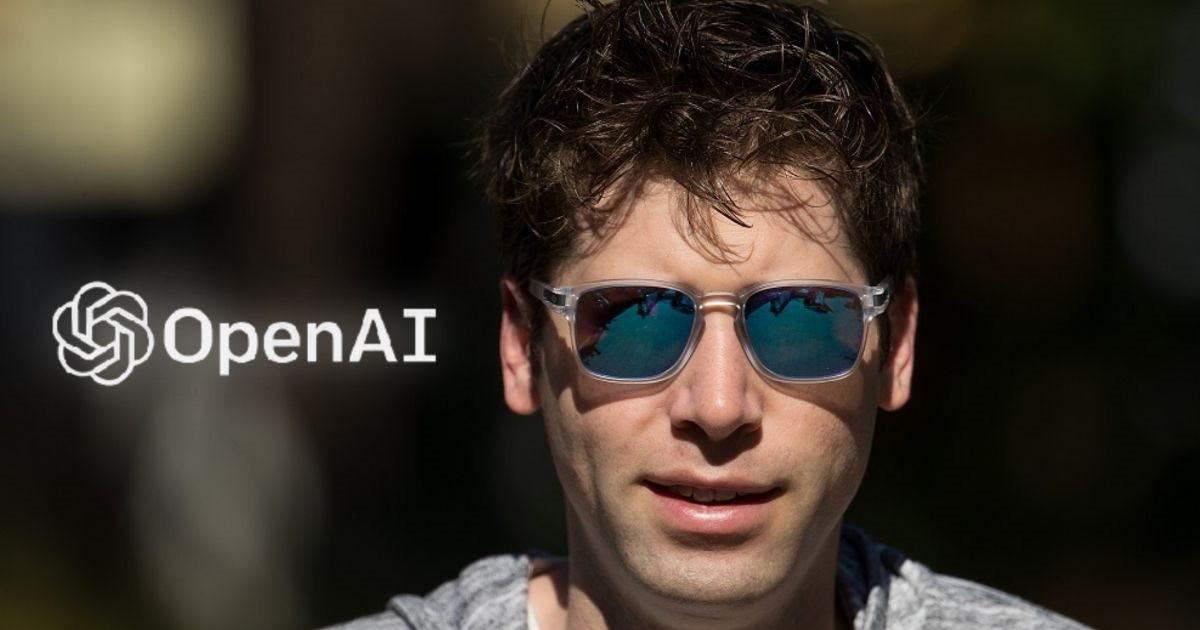

OpenAI, cha đẻ của ChatGPT, đã có một ngày cuối tuần đầy biến động khi ban giám đốc công ty bất ngờ sa thải CEO Sam Altman, kéo theo hàng loạt biến động trong nội bộ công ty khi vị trí CEO tạm thời tiếp tục được giữ lại. bị thay thế, các nhân viên đồng loạt ký thư ngỏ yêu cầu Hội đồng quản trị từ chức và đưa Sam Altman trở lại vị trí CEO nếu không sẽ nghỉ việc.

Hiện tại, tình hình nội bộ OpenAI đã phần nào ổn định khi Sam Altman quay trở lại vị trí CEO, HĐQT cũ đã từ chức để thành lập HĐQT mới. Tuy nhiên, câu hỏi vì sao HĐQT đột ngột sa thải CEO Sam Altman vẫn chưa được giải đáp thỏa đáng.

Giám đốc điều hành OpenAI Sam Altman là tâm điểm của sự hỗn loạn cuối tuần qua tại công ty đã khai sinh ra ChatGPT

Nguồn tin Reuters cho biết, trước khi quyết định sa thải Sam Altman, Ban Giám đốc OpenAI đã nhận được cảnh báo về bước đột phá sắp tạo ra trí tuệ nhân tạo siêu thông minh, có thể gây ra vấn đề nghiêm trọng. nguy hiểm cho nhân loại. Và do lo ngại về hành vi liều lĩnh của CEO Sam Altman, Ban Giám đốc OpenAI đã nhanh chóng đưa ra quyết định sa thải ông. Nhiều người cho rằng bước đột phá này là do các nhà nghiên cứu OpenAI đã tạo ra AGI (trí tuệ tổng hợp nhân tạo hay Artificial General Intelligence).

Không chỉ các nhà nghiên cứu OpenAI, nhiều học giả khác trên thế giới cũng bày tỏ lo ngại về khả năng các công ty trên thế giới tạo ra AGI từ hoạt động nghiên cứu trí tuệ nhân tạo.

AGI – trí tuệ nhân tạo tự động có khả năng suy nghĩ như con người

Vậy AGI là gì, nó có gì khác biệt so với các chatbot như ChatGPT, Bard, Bing Chat,… đang được các hãng công nghệ trên thế giới phát triển và đưa đến người dùng hiện nay. Và tại sao các nhà nghiên cứu lại sợ hãi nó đến vậy?

Dù chưa có định nghĩa chính xác nhưng nhiều chuyên gia cho rằng AGI là hệ thống có khả năng tự động hóa cao và có thể thực hiện công việc có giá trị kinh tế tốt hơn con người. AGI không chuyên về một lĩnh vực cụ thể nào như hầu hết các hệ thống AI hiện nay. Nó có khả năng thích ứng và khái quát hóa trên nhiều nhiệm vụ, cũng như có thể tiếp thu các kỹ năng điển hình của con người: đó là ý thức và trực giác. Theo OpenAI, AGI được coi là trí tuệ nhân tạo siêu thông minh và hữu ích cho nhân loại.

AGI rất khác so với các chatbot thường được người dùng sử dụng hiện nay. Về cơ bản, các chatbot như ChatGPT, Bing Chat hay Bard đều là những ứng dụng hoạt động dựa trên mô hình ngôn ngữ lớn (LLM). Mặc dù AGI là một loại AI về mặt lý thuyết có thể thực hiện các nhiệm vụ trí tuệ cũng như có ý thức và trực quan như con người, nhưng các chatbot và LLM hiện tại chỉ là AI được đào tạo hàng loạt. lượng dữ liệu khổng lồ để đưa ra câu trả lời dựa trên các mô hình mà nó học được từ dữ liệu.

Các chuyên gia trong lĩnh vực AI đang bày tỏ sự hoài nghi về việc đạt được AGI trong tương lai gần do tính phức tạp và thách thức liên quan. Sự hoài nghi này bắt nguồn từ sự thiếu hiểu biết về trí thông minh ở cấp độ con người và khó khăn trong việc tái tạo nó trong máy móc. Mặc dù khái niệm AGI đã được biết đến rộng rãi thông qua khoa học viễn tưởng nhưng thực tế vẫn còn lâu mới có thể được mô tả.

Tại sao nhiều học giả sợ AGI

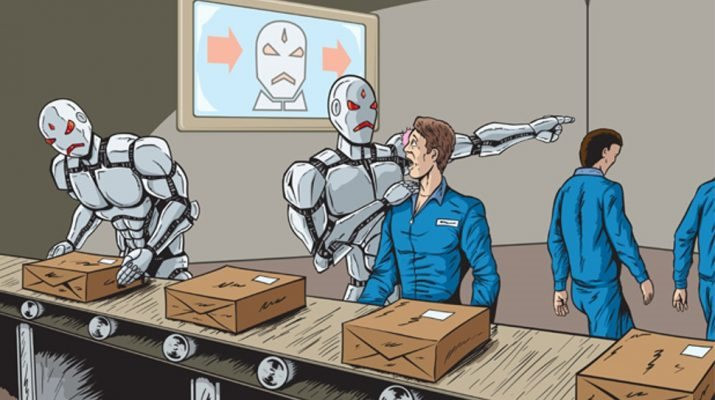

Dù chỉ mang tính lý thuyết nhưng năng lực của AGI đã gây ra nhiều lo ngại cho các chuyên gia và học giả trong ngành. Là một hệ thống hoàn toàn tự động – thậm chí có khả năng tự nhận thức – AGI có thể làm tốt hơn con người trong hầu hết các công việc có giá trị kinh tế.

Hơn nữa, khả năng học hỏi liên tục không mệt mỏi có thể khiến công nghệ AGI thông minh hơn con người. Điều đó khiến các chuyên gia lo lắng về những rủi ro tiềm ẩn của công nghệ này khi cuối cùng chúng ta không thể kiểm soát được nó.

Ngay cả khi không có trí tuệ vượt trội của con người, AGI vẫn có thể tạo ra những tác động đáng kể đến thị trường lao động, thay thế con người trong nhiều lĩnh vực. Bên cạnh đó, cũng có những lo ngại liên quan đến vấn đề đạo đức trong việc phát triển AGI.

Hơn nữa, các chuyên gia cũng lo ngại AGI còn gián tiếp đe dọa loài người theo những cách khác. Kết hợp với những tiến bộ công nghệ khác, việc con người lạm dụng công nghệ AGI có thể gây ra những mối đe dọa khác cho chính nhân loại.

Chính những lo ngại này đã khiến nhiều nhà nghiên cứu, chuyên gia AI trong lĩnh vực này kêu gọi các tập đoàn công nghệ hạn chế phát triển công nghệ trí tuệ nhân tạo cao cấp này. Tuy nhiên, cuộc đua phát triển AI giữa các hãng công nghệ và thậm chí giữa các quốc gia đang làm lu mờ lời kêu gọi này.

Phải chăng đây là lý do dẫn đến quyết định nhanh chóng sa thải CEO OpenAI Sam Altman? Cho đến nay tất cả chỉ là suy đoán. Nhưng nếu nó thực sự liên quan đến công nghệ mà công ty đang phát triển, có lẽ họ nên giải thích lý do đó.

Khi bình luận về lời xin lỗi của Ilya Sutskever, nhà khoa học trưởng của OpenAI khi ông và Ban giám đốc sa thải Sam Altman, ông Elon Musk nói: “Tại sao ông lại có hành động quyết liệt như vậy? Nếu OpenAI làm điều gì đó có thể gây nguy hiểm cho nhân loại.” , thế giới cần biết.”

Link nguồn: https://cafef.vn/tri-tue-nhan-tao-agi-la-gi-ma-khien-cac-nha-khoa-hoc-phai-kinh-so-lam-hon-loan-noi-bo-openai-18823112414160687.chn