Với sự phát triển của công nghệ, tội phạm mạng không ngừng tìm kiếm những cách thức mới để thực hiện hành vi lừa đảo. Một trong những công nghệ mới được nhóm này sử dụng là phần mềm mô phỏng giọng nói.

Ví dụ: Giám đốc điều hành của một công ty cung cấp năng lượng ở Anh từng chuyển 249.000 đô la cho một kẻ lừa đảo trực tuyến sau khi nhận được cuộc gọi từ một người có vẻ là người đứng đầu công ty mẹ (Đức) của ông ta. Đang làm việc.

Theo đó, CEO này được yêu cầu chuyển tiền cho một nhà cung cấp ở Hungary. Không nghi ngờ gì về giọng nói ở đầu dây bên kia, anh đã rơi vào bẫy của kẻ lừa đảo và mất hết tiền.

Giọng nói do AI tạo ra có thể được sử dụng để lừa đảo (Ảnh: Tech Xplore).

Rudiger Kirsch, chuyên gia lừa đảo, cho biết giọng nói đó thực chất được tạo ra bằng trí tuệ nhân tạo (AI). Các chuyên gia an ninh mạng từ lâu đã lo ngại về những gì tin tặc có thể làm với AI, chẳng hạn như tạo một video trong đó giám đốc điều hành công ty muốn biết mật khẩu của bạn.

Phần mềm AI hiện có khả năng thực hiện việc này trong thời gian thực, nghĩa là tin tặc hoàn toàn có thể giả làm sếp của bạn trong cuộc gọi Zoom.

Vào ngày 17 tháng 8, các nhà nghiên cứu tại công ty an ninh mạng Mandiant thuộc sở hữu của Google đã ghi lại một số trường hợp đầu tiên về công nghệ video deepfake (gán khuôn mặt của người này cho người khác trong video). được thiết kế và bán cho những kẻ lừa đảo.

Quảng cáo trên các diễn đàn hacker và kênh Telegram cho thấy chi phí của dịch vụ này chỉ khoảng 20 USD/phút video, 250 USD cho một video đầy đủ hoặc 200 USD cho một video hướng dẫn.

Luke McNamara, nhà phân tích chính tại Mandiant, cho biết các nhà nghiên cứu không thể xác nhận rằng dịch vụ mà họ xác định trên các diễn đàn hacker là hợp pháp hay liệu các kỹ thuật deepfake có được sử dụng trong bất kỳ vụ lừa đảo nào hay không. hay không, nhưng mối đe dọa của công nghệ này là có thật.

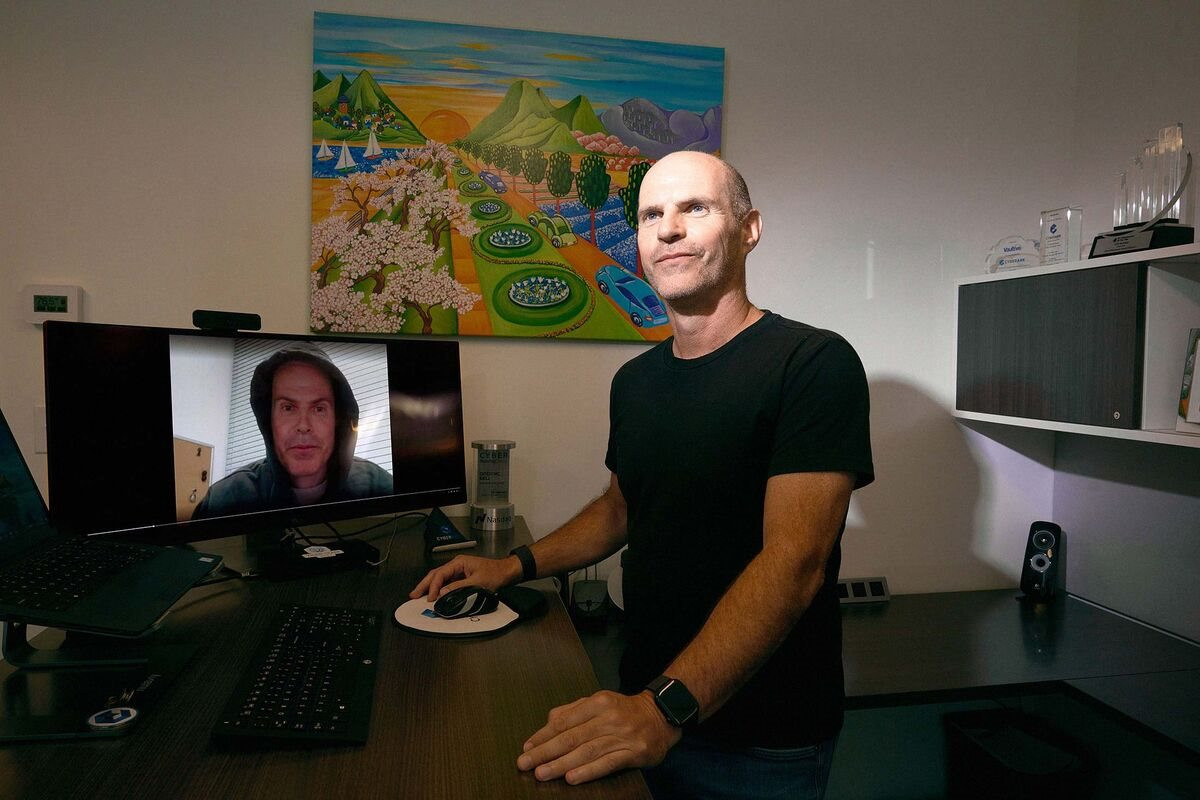

Mới đây, Udi Mokady – chủ tịch công ty bảo mật thông tin CyberArk Software đã có trải nghiệm thực tế với kiểu tấn công này. Trong một cuộc họp trực tuyến qua Microsoft Teams, anh ấy đã phải đối mặt với deepfake của chính mình. Mokady chia sẻ: “Tôi đã bị sốc khi nhìn thấy mình ở phía bên kia với văn phòng của mình ở phía sau.

Udi Mokady và video deepfake mạo danh chính mình (Ảnh: Bloomberg).

Việc này được thực hiện bởi Gal Zror, một trong những nhân viên của Mokady. Zror đã sử dụng các công cụ AI tổng hợp miễn phí để tái tạo hình ảnh của Mokady nhằm cảnh báo cấp trên về sự nguy hiểm của công nghệ deepfake.

“Vì mọi người đã quen với chất lượng âm thanh và video không quá tốt trong các cuộc gọi trực tuyến nên video deepfake dù không hoàn hảo nhưng vẫn đủ sức đánh lừa. Tôi đã mất vài ngày để hoàn thành dự án trên và một người không rành về kỹ thuật nhưng có khả năng tính toán tốt có thể thực hiện nó trong vòng vài tuần”, Zror nói thêm.

Mokady cho rằng nhân viên của công ty (tất cả đều am hiểu công nghệ) có thể phát hiện video của Zror là giả, nhưng một người bình thường khó có thể phân biệt được.

Các chuyên gia bảo mật cảnh báo những kẻ lừa đảo đang lợi dụng sự phát triển của công nghệ, đặc biệt là AI để nghĩ ra nhiều cách lừa đảo tiền của người dân. Vì vậy, với bất kỳ yêu cầu chuyển tiền hay lộ mật khẩu nào, bạn cũng nên cẩn thận và xác minh thật kỹ để tránh rơi vào bẫy lừa đảo.

Link nguồn: https://cafef.vn/canh-bao-rui-ro-khon-luong-cho-nhung-ai-hay-ban-chuyen-cong-viec-qua-dien-thoai-dung-de-tien-roi-188230830200540687.chn